Ética Laboral y IA: Navegando el Uso Responsable y los Riesgos Reales

La inteligencia artificial (IA) ya no es una visión futurista; es una realidad palpable que está remodelando el panorama laboral a un ritmo vertiginoso. Desde la optimización de procesos hasta la toma de decisiones complejas, los sistemas de IA se infiltran en casi todos los ámbitos empresariales. Si bien la promesa de eficiencia, innovación y crecimiento es innegable, esta revolución tecnológica también trae consigo un conjunto de desafíos éticos sin precedentes, especialmente en lo que respecta al mundo del trabajo. La forma en que las empresas y los empleados naveguemos esta intersección determinará no solo el futuro de las organizaciones, sino también el bienestar y la equidad de la fuerza laboral. Este artículo se propone explorar la urgencia de la ética laboral en la era de la IA, desentrañar los riesgos reales que enfrentamos y ofrecer estrategias claras para un uso responsable y beneficioso de estas poderosas tecnologías.

La IA en el Ecosistema Laboral y la Urgencia Ética

La integración de la inteligencia artificial en el ámbito laboral ha dejado de ser una mera posibilidad para convertirse en una constante. Las empresas de todos los tamaños y sectores están implementando diversas tecnologías de IA para mejorar su productividad, agilizar operaciones y obtener una ventaja competitiva. Desde asistentes virtuales que gestionan la comunicación hasta algoritmos complejos que predicen tendencias de mercado, los sistemas de IA se han vuelto herramientas indispensables. Sin embargo, esta rápida adopción no siempre va de la mano con una reflexión profunda sobre sus implicaciones éticas. La eficiencia y la innovación son motores poderosos, pero no deben eclipsar la necesidad de considerar el impacto humano y social de estas tecnologías.

La Revolución de la Inteligencia Artificial y su Profunda Penetración en el Trabajo

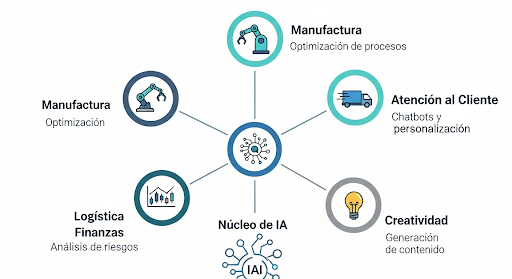

La IA está rediseñando múltiples sectores laborales, desde la automatización de la logística hasta la asistencia en procesos creativos.

Vivimos una era donde la Inteligencia Artificial se ha convertido en un motor de cambio fundamental en casi todos los ámbitos laborales. La capacidad de los sistemas de IA para procesar grandes volúmenes de datos, aprender de patrones y realizar tareas con una velocidad y precisión sobrehumanas ha transformado la manera en que trabajamos. Sectores como la manufactura, la atención al cliente, la logística, las finanzas e incluso la creatividad están siendo rediseñados por la IA. Las empresas ven en estas tecnologías una vía para optimizar recursos, personalizar experiencias y descubrir nuevas oportunidades de negocio. La automatización de tareas rutinarias libera a los empleados para que se enfoquen en labores de mayor valor estratégico, promoviendo así un entorno laboral más dinámico y, en teoría, más gratificante.

¿Por Qué la Ética Laboral es Crucial Ahora? (Más allá de la eficiencia)

La pregunta sobre la ética en la IA se ha vuelto más apremiante que nunca. Si bien la búsqueda de eficiencia es un objetivo legítimo para cualquier empresa, basar el progreso únicamente en métricas de productividad sin considerar las implicaciones éticas puede llevar a consecuencias negativas. El desarrollo y despliegue de sistemas de IA impactan directamente en la vida de las personas: su seguridad laboral, su privacidad, su dignidad y su bienestar. Ignorar la ética no solo pone en riesgo la confianza del público y de los empleados, sino que también puede generar desigualdades profundas y problemas legales y reputacionales. Por ello, la ética laboral en la IA no es un añadido opcional, sino un pilar fundamental para un futuro sostenible y equitativo.

Equilibrio entre Innovación y Responsabilidad

Nuestro objetivo con este artículo es tender un puente entre la fascinante revolución de la IA y la imperiosa necesidad de un uso responsable. Buscamos ofrecer una guía clara y accesible, tanto para las empresas como para los empleados, sobre cómo navegar este nuevo territorio tecnológico. Abordaremos los riesgos reales que la IA presenta en el ámbito laboral y exploraremos estrategias concretas para mitigar dichos riesgos, promoviendo la transparencia, la equidad y la responsabilidad. Se trata de encontrar el equilibrio perfecto entre abrazar la innovación que la IA nos ofrece y asegurarnos de que su implementación se alinee con nuestros valores humanos y éticos. Queremos que la IA sea una herramienta de empoderamiento, no de marginación, y que la confianza sea el cimiento sobre el que se construyan las relaciones laborales del futuro.

Los Fundamentos Éticos de la IA en el Contexto Laboral

Para abordar la integración de la IA en el trabajo de manera responsable, es esencial comprender los principios éticos que deben guiar su desarrollo y aplicación. Estos principios no son meras directrices teóricas, sino que forman la base para construir sistemas de IA que sean justos, transparentes y beneficiosos para todos. La ética laboral aplicada a la IA busca asegurar que las tecnologías potencien las capacidades humanas en lugar de socavarlas, y que la responsabilidad sea un elemento central en cada decisión.

Principios Clave de la Ética de la IA Aplicados al Trabajo

Los pilares de una IA ética en el entorno laboral incluyen la transparencia, la explicabilidad, la equidad, la privacidad, la responsabilidad y la seguridad. La transparencia implica que los procesos de toma de decisiones de la IA sean comprensibles, al menos en un nivel funcional, para quienes se ven afectados por ellos. La equidad exige que los algoritmos no discriminen a ningún grupo de personas, abordando activamente los sesgos inherentes. La privacidad es fundamental, especialmente en lo que respecta a los datos de los empleados. La responsabilidad recae en quienes diseñan, implementan y supervisan los sistemas de IA para garantizar que funcionen como se espera y para responder por sus resultados. Finalmente, la seguridad y la fiabilidad son cruciales para prevenir fallos o usos indebidos de las tecnologías.

La IA como Herramienta de Apoyo, No de Sustitución Humana

Un principio ético primordial es concebir la IA como una herramienta de apoyo y mejora de las capacidades humanas, no como un reemplazo total y sin matices. Si bien la automatización es una realidad, el objetivo debería ser potenciar la inteligencia humana, la creatividad, la empatía y el pensamiento crítico. Los sistemas de IA deben diseñarse para colaborar con los empleados, liberándolos de tareas monótonas y permitiéndoles enfocarse en aspectos más complejos y gratificantes de su trabajo. Este enfoque centrado en el ser humano no solo optimiza el rendimiento, sino que también salvaguarda la dignidad y el propósito del trabajador, construyendo confianza y fomentando un ambiente laboral más positivo y productivo. El desarrollo de la IA debe priorizar la colaboración humano-máquina para obtener los mejores resultados para las empresas y sus empleados.

Riesgos Reales y Desafíos Éticos de la IA en el Ámbito Laboral

La adopción de la IA en el trabajo, si bien prometedora, no está exenta de riesgos significativos. La complejidad de los algoritmos, la dependencia de los datos y la rápida evolución de estas tecnologías presentan desafíos éticos que requieren una atención constante y proactiva por parte de las empresas. Ignorar estos riesgos puede tener consecuencias graves para los empleados, las organizaciones y la sociedad en su conjunto, perpetuando desigualdades y erosionando la confianza.

Sesgos Algorítmicos y Discriminación en Procesos de Recursos Humanos

Uno de los riesgos más documentados y preocupantes es el de los sesgos algorítmicos. Los sistemas de IA, al ser entrenados con datos históricos, pueden involuntariamente aprender y amplificar sesgos existentes en la sociedad. Esto es especialmente crítico en los ámbitos de recursos humanos, donde la IA se utiliza para la selección de personal, la evaluación del desempeño o las promociones. Si los datos de entrenamiento reflejan discriminación histórica basada en género, raza, edad u otras características, los algoritmos resultantes pueden perpetuar e incluso exacerbar estas desigualdades. Esto puede llevar a decisiones injustas, excluyendo a candidatos cualificados o penalizando a empleados basándose en criterios no relacionados con su mérito, afectando directamente la equidad y la responsabilidad en la empresa.

Privacidad y Vigilancia Laboral Intensificada por la IA

Las tecnologías de IA otorgan a las empresas capacidades sin precedentes para monitorizar a sus empleados. Desde el seguimiento de la actividad en el ordenador hasta el análisis del comportamiento y la productividad en tiempo real, la vigilancia laboral intensificada por la IA plantea serias preocupaciones sobre la privacidad. La recopilación masiva de datos personales de los trabajadores, a menudo sin un consentimiento plenamente informado o una justificación clara, puede erosionar la confianza, generar estrés y afectar negativamente el bienestar y la salud mental. Establecer límites claros y garantizar la privacidad de los empleados es un reto ético fundamental para cualquier empresa que implemente estas herramientas.

Impacto en la Autonomía, el Bienestar y la Salud Mental del Trabajador

La constante supervisión, la presión por cumplir métricas dictadas por algoritmos y la incertidumbre sobre el futuro laboral debido a la automatización pueden tener un impacto profundo en la autonomía, el bienestar y la salud mental de los trabajadores. El 30% de los trabajadores a nivel mundial temen que la IA pueda reemplazar sus empleos dentro de los próximos tres años, según una encuesta de PwC. Este temor, sumado a la sensación de ser constantemente evaluado por un sistema impersonal, puede generar ansiedad, agotamiento y una disminución de la satisfacción laboral. La IA, si no se implementa de manera ética, puede deshumanizar el trabajo, erosionando la confianza y el sentido de propósito de los empleados.

La "Caja Negra" de la IA: Falta de Transparencia y Explicabilidad

Muchos sistemas de IA, especialmente los modelos de aprendizaje profundo, funcionan como una "caja negra": sus decisiones se basan en complejas interacciones de algoritmos y datos que son difíciles de comprender incluso para los expertos. Esta falta de transparencia y explicabilidad presenta un desafío ético significativo. Cuando las decisiones importantes, como la contratación o el despido, se toman a través de un sistema opaco, es difícil para los empleados o incluso para la gerencia comprender el razonamiento detrás de ellas. Esto socava la responsabilidad y dificulta la identificación y corrección de posibles sesgos o errores.

Desinformación y "Alucinaciones" de Modelos de IA Generativa

La reciente proliferación de modelos de IA generativa ha introducido nuevos riesgos en el ámbito laboral. Estas tecnologías son capaces de crear contenido —texto, imágenes, código— de manera asombrosa, pero también son propensas a generar "alucinaciones": información incorrecta o ficticia presentada como hechos. En un entorno profesional, el uso de contenido generado por IA sin una verificación rigurosa puede llevar a la propagación de desinformación, a la toma de decisiones basadas en datos falsos o a la creación de material difamatorio o engañoso. La empresa tiene la responsabilidad de garantizar la precisión y la veracidad de la información utilizada, incluso cuando es generada por sistemas de IA.

Navegando el Uso Responsable: Estrategias para Empresas

Ante los riesgos inherentes a la IA, las empresas deben adoptar un enfoque proactivo y centrado en la ética para su desarrollo e implementación. La responsabilidad corporativa es clave para construir confianza y asegurar que estas tecnologías sirvan a propósitos beneficiosos. Implementar marcos sólidos y políticas claras no solo mitiga los riesgos, sino que también puede convertirse en una ventaja competitiva.

Desarrollar un Marco Ético de IA Corporativo y una Gobernanza Robusta

El primer paso crucial para las empresas es establecer un marco ético de IA claro y bien definido. Este marco debe incluir directrices sobre cómo se deben desarrollar, implementar y utilizar los sistemas de IA, abordando explícbiamente principios como la transparencia, la equidad y la privacidad. Junto a esto, es vital una gobernanza robusta que designe responsabilidades claras para la supervisión de la IA y establezca mecanismos para la toma de decisiones éticas. Un comité de ética de IA o roles dedicados pueden asegurar que las consideraciones éticas sean parte integral de todo el ciclo de vida de la IA, desde la concepción hasta el despliegue y el mantenimiento, asegurando que los algoritmos no generen desigualdades.

Implementar Auditorías de IA y Evaluaciones de Impacto Ético Continuas

La IA evoluciona constantemente, y con ella, sus posibles riesgos. Por ello, es indispensable implementar un proceso continuo de auditorías de IA y evaluaciones de impacto ético. Estas auditorías deben ir más allá de la verificación técnica para evaluar activamente si los sistemas de IA están funcionando de manera justa y transparente, si están libres de sesgos perjudiciales y si respetan la privacidad de los empleados. Las evaluaciones de impacto ético deben anticipar posibles consecuencias negativas antes de que los sistemas se implementen a gran escala. Menos del 20% de las empresas afirma tener un despliegue avanzado de IA ética y transparente, según Experis 2025 (citado por Corresponsables), lo que subraya la necesidad crítica de estas prácticas.

Fomentar la Transparencia y la Explicabilidad en los Sistemas de IA

Fomentar la transparencia y la explicabilidad en los sistemas de IA es un componente esencial para generar confianza y permitir la responsabilidad. Esto no siempre significa que cada empleado deba entender la matemática detrás de un modelo de aprendizaje profundo, pero sí que deben ser informados sobre cuándo y cómo se está utilizando la IA en sus procesos laborales. Las empresas deben esforzarse por proporcionar explicaciones claras sobre las decisiones tomadas por la IA, especialmente cuando estas afectan directamente a los empleados. Cuando sea posible, se deben preferir algoritmos que permitan una mayor interpretabilidad, facilitando la identificación y corrección de posibles fallos o discriminaciones.

Invertir en Formación Continua y Reskilling para Empleados

La automatización impulsada por la IA está transformando los roles laborales, y es responsabilidad de las empresas preparar a su fuerza laboral para estos cambios. Esto implica invertir en formación continua y programas de reskilling (recualificación). Las empresas deben identificar las habilidades que serán más demandadas en un futuro mediado por la IA —como el pensamiento crítico, la creatividad, la inteligencia emocional y la alfabetización digital avanzada— y ofrecer oportunidades para que los empleados desarrollen estas competencias. El desarrollo profesional continuo es crucial para asegurar que los empleados puedan adaptarse a nuevos roles y seguir siendo valiosos en un entorno laboral en constante evolución, mitigando el temor a la pérdida de empleo.

Priorizar la Privacidad y la Seguridad de los Datos del Empleado

La privacidad y la seguridad de los datos de los empleados deben ser una prioridad absoluta al implementar sistemas de IA. Las empresas deben adherirse a las normativas de protección de datos vigentes (como el GDPR en Europa) y adoptar prácticas rigurosas para la recolección, almacenamiento y uso de información personal. Se debe ser transparente sobre qué datos se recopilan, por qué se recopilan y cómo se protegen. La implementación de medidas de seguridad robustas es vital para prevenir brechas de datos que podrían tener consecuencias devastadoras para los empleados.

Promover la Diversidad e Inclusión en el Desarrollo y Despliegue de IA

Para combatir los sesgos algorítmicos y asegurar que la IA beneficie a todos, es fundamental promover la diversidad y la inclusión tanto en el desarrollo como en el despliegue de estas tecnologías. Los equipos que diseñan y prueban los sistemas de IA deben reflejar la diversidad de la sociedad. La inclusión de diferentes perspectivas durante el desarrollo puede ayudar a identificar riesgos de sesgos potenciales y a crear sistemas de IA más equitativos y justos. Las empresas deben buscar activamente la representación de diversos grupos demográficos y experiencias en todas las etapas del ciclo de vida de la IA.

El Rol del Empleado en la Era de la IA Ética: Conocimiento y Participación

En la era de la IA, el empleado no es un mero espectador, sino un actor fundamental en la construcción de un entorno laboral ético y responsable. Comprender el impacto de la IA en el propio puesto de trabajo, defender la transparencia y participar activamente en la cultura de la empresa son acciones clave para garantizar que la tecnología sirva al progreso humano. El conocimiento y la proactividad son las herramientas más poderosas del trabajador en esta transición.

Entender Cómo la IA Afecta su Puesto de Trabajo

El primer paso para un empleado es informarse. Es vital comprender cómo los sistemas de IA están siendo utilizados o planeados para ser utilizados dentro de la empresa y cómo pueden afectar las tareas, responsabilidades y el futuro del propio puesto de trabajo. Esta comprensión permite anticipar cambios, identificar posibles riesgos y prepararse para las nuevas dinámicas laborales. El 21,1% de las empresas españolas de 10 o más trabajadores adoptó alguna tecnología de IA en sus procesos productivos en 2024, según la Fundación Cotec, lo que demuestra la urgencia de esta alfabetización digital.

Defender la Transparencia y el Derecho a la Explicación

Los empleados tienen derecho a saber cuándo se están utilizando sistemas de IA en su contra o para tomar decisiones que les afectan. Defender la transparencia significa preguntar, indagar y exigir claridad sobre cómo funcionan estos sistemas y por qué se toman ciertas decisiones. Si un algoritmo ha tomado una decisión sobre una evaluación de desempeño, una promoción o incluso un despido, el empleado debería tener el derecho a solicitar una explicación comprensible. Esta demanda activa de transparencia presiona a las empresas a ser más responsables en su uso de la IA.

Adaptarse y Desarrollar Nuevas Habilidades (Aprendizaje Continuo)

La automatización y la IA están redefiniendo las habilidades necesarias en el mercado laboral. Los empleados deben abrazar el aprendizaje continuo y el reskilling para mantenerse relevantes. Esto implica estar abiertos a adquirir nuevas competencias, a adaptarse a nuevas herramientas y a colaborar con sistemas de IA. Ver la IA no como una amenaza, sino como una herramienta que puede potenciar el propio trabajo y abrir nuevas oportunidades es un cambio de mentalidad esencial. El desarrollo de habilidades humanas únicas, como la creatividad, el pensamiento crítico y la inteligencia emocional, se vuelve aún más valioso.

Reportar Usos No Éticos o Preocupaciones

Si un empleado identifica un uso de la IA que considera no ético, discriminatorio, invasivo o de cualquier otra forma problemático, es fundamental que tenga canales seguros y efectivos para reportar estas preocupaciones. Las empresas deben fomentar una cultura de confianza donde los empleados se sientan cómodos expresando sus inquietudes sin temor a represalias. Un mecanismo de denuncia robusto, junto con una respuesta seria y proactiva por parte de la dirección, es esencial para abordar los riesgos y garantizar la responsabilidad.

El Paisaje Regulatorio y los Estándares Globales en Ética de la IA Laboral

La creciente omnipresencia de la IA ha impulsado la necesidad de un marco regulatorio y de estándares que guíen su desarrollo y uso ético. Gobiernos y organizaciones internacionales están trabajando para establecer normativas que protejan a los ciudadanos y trabajadores de los riesgos potenciales de estas tecnologías, al tiempo que fomentan la innovación responsable. La IA es un fenómeno global, por lo que la coordinación internacional y el establecimiento de estándares comunes son cruciales.

Regulaciones Internacionales y Regionales Relevantes

Organismos como la Unión Europea han avanzado significativamente en la regulación de la IA, siendo su propuesta de Ley de Inteligencia Artificial (AI Act) un hito importante. Esta ley busca clasificar los sistemas de IA según su nivel de riesgo, imponiendo requisitos más estrictos a aquellos considerados de alto riesgo, como los utilizados en áreas laborales críticas. A nivel internacional, organizaciones como la UNESCO han publicado recomendaciones sobre ética de la IA, promoviendo un enfoque centrado en los derechos humanos y la dignidad. El 82% de las personas cree que es necesaria una regulación nacional e internacional de la IA, según KPMG International 2025, reflejando una demanda social clara.

La Necesidad de Políticas Específicas para el Trabajo

Si bien las regulaciones generales sobre IA son importantes, existe una necesidad creciente de políticas más específicas centradas en el ámbito laboral. Estas políticas deberían abordar cuestiones como la automatización y su impacto en el empleo, la vigilancia de los trabajadores, el uso de algoritmos en la toma de decisiones de recursos humanos y la formación y reskilling de la fuerza laboral. La colaboración entre gobiernos, empresas, sindicatos y expertos es fundamental para desarrollar políticas efectivas que protejan los derechos de los trabajadores y promuevan un uso justo y equitativo de la IA.

Estándares y Certificaciones para una IA Ética

Más allá de las regulaciones, el desarrollo de estándares y certificaciones para la IA ética es una vía prometedora para promover la adopción de mejores prácticas. Organismos como la Organización Internacional de Normalización (ISO) están trabajando en estándares relacionados con la gestión de riesgos y la fiabilidad de los sistemas de IA. Estas certificaciones pueden proporcionar a las empresas un marco para evaluar y demostrar su compromiso con la IA responsable, y a los consumidores y empleados, una garantía de que las tecnologías que utilizan cumplen con criterios éticos preestablecidos.

La inteligencia artificial está redefiniendo el panorama laboral, ofreciendo un potencial inmenso para la innovación y la eficiencia. Sin embargo, para capitalizar plenamente estos beneficios, debemos navegar este territorio con una brújula ética firme. Hemos explorado la penetración de la IA en los ámbitos laborales, los riesgos reales y a menudo subestimados de los sesgos, la falta de transparencia, la erosión de la privacidad y el impacto en la autonomía y el bienestar de los trabajadores.

La responsabilidad recae tanto en las empresas, que deben desarrollar marcos éticos robustos, implementar auditorías y priorizar la transparencia, como en los empleados, quienes deben informarse, participar activamente y abogar por un uso justo de la tecnología. El hecho de que menos del 20% de las empresas afirma tener un despliegue avanzado de IA ética y transparente subraya la urgencia de una acción concertada.

Las políticas regulatorias a nivel nacional e internacional, junto con el establecimiento de estándares y certificaciones, son cruciales para guiar este camino. Sin embargo, la confianza y la ética en la IA no son solo cuestiones de cumplimiento, sino la base para un futuro laboral sostenible y equitativo. Las empresas que invierten en formación continua y reskilling, que promueven la diversidad en el desarrollo de la IA y que priorizan la privacidad de los datos de sus empleados, no solo mitigan riesgos, sino que construyen una cultura de confianza y un entorno de trabajo más resiliente y humano.

Abrazar la IA de manera ética no es una opción, es una necesidad para asegurar que estas poderosas tecnologías potencien a la humanidad, refuercen la equidad y contribuyan a un futuro donde la innovación y los valores humanos coexistan armoniosamente. El camino hacia una IA laboral ética requiere un compromiso continuo, diálogo abierto y una acción decidida por parte de todos los actores involucrados.

Add a comment